[단비현장] 서울대 언론정보연구소 국제학술심포지엄

“봇 계정(자동생성글을 올리는 계정) 등 소셜미디어를 통해 자동화한 오정보(misinformation)가 전파되는 것이 전 세계적 현상임을 확인했습니다. 50~60개 국에서 심화연구를 진행하고 그 외 수십 개 국에서 가벼운 트렌드 조사를 한 결과 정당, 선거 후보자 등 정치계에서 생산한 오정보가 없는 나라는 거의 없었습니다.”

13일 낮 12시 줌(zoom) 화상회의로 열린 ‘허위정보 국제학술심포지엄’의 1차 세미나에서 기조발표를 맡은 필립 하워드 영국 옥스퍼드대 인터넷연구소장이 말했다. 서울대 언론정보연구소가 주최하고 한국언론진흥재단과 구글 뉴스랩이 지원한 이 세미나에서는 서울대 언론정보학과 이은주 교수가 사회를 맡고 한규섭 교수가 토론에 나섰다.

미국 대선에서 러시아 ‘봇 계정’ 대거 활동

하워드 교수는 ‘거짓말 기계’를 제목으로 한 발표에서 허위정보(disinformation)와 오정보를 생산하고 배포하는 과정이 대부분 기계화한 시스템에 의해 이뤄진다고 말했다. 그는 정당 등 사회조직이 사회관계망서비스(SNS) 플랫폼 등 기술 메커니즘과 결합해 진실되지 않은 주장을 생산하고 선전에 나선다고 지적했다. 하워드 교수는 이를 ‘컴퓨테이셔널 프로파간다(Computational Propaganda)’라고 소개하며, 속이려는 의도를 가진 ‘허위정보’와 잘못된 내용을 담았지만 의도 없이 전파되는 ‘오정보’를 생산하고 배포하는 메커니즘이라고 설명했다.

그는 자신의 연구팀이 많은 양의 정치 트윗을 빠르게 올리는 봇 계정을 분석한 결과 2016년 미국 대선에서 러시아가 관리하는 3500개 계정이 대선 토론회, 선거 당일 등에 자동화한 악성댓글 활동을 최대로 펼쳤던 것으로 나타났다고 밝혔다. 중국, 인도, 이란, 파키스탄 등 러시아를 모방하는 국가도 많이 나타났다고 한다. 예를 들어 중국은 홍콩 민주화 시위 이후 영어 사용자를 대상으로 ‘오정보’를 확산하는 전방위 작업을 진행했다는 것이다.

국내에서 ‘가짜뉴스’로 통용되는 허위정보와 오정보는 전 세계에서 진실을 왜곡하고 민주주의를 위협하는 것으로 지적되고 있다. 하워드 교수는 “속이려는 의도를 가진 허위정보도 문제지만, 잘못된 내용을 담고도 의도 없이 전파되는 오정보의 폐해가 더 심각하다”고 말했다.

역대 대선에 빠짐없이 등장한 '가짜뉴스'와 선동

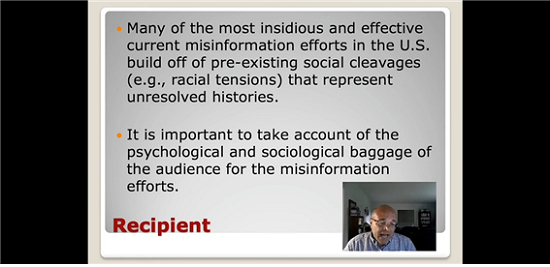

랜스 홀버트 미국 템플대학교 교수는 ‘미 대선에서의 오정보: 더럽혀진 역사’를 주제로 두 번째 발표에 나섰다. 그는 하워드 교수와 달리 오정보라는 개념 안에 허위정보, 온라인·오프라인 프로파간다(선전), 당파색을 띤 뉴스, 가짜뉴스, 낚시 정보, 루머, 음모론이 모두 포함되는 것으로 설명했다.

홀버트 교수는 미국에서 대중 정당이 조직된 1800년 이후 모든 대선에서 허위정보, 프로파간다 등이 지속적으로 등장했다고 지적했다. 그는 현재의 오정보 활동도 과거와 다르지 않지만, 디지털 시대가 되면서 과거 어떤 시대보다 오정보의 규모가 커졌다는 것에 주목했다. 전파자들이 디지털 환경에서 선동 효과가 큰 방식을 찾기 위해 여러 시도를 할 수 있게 됐고, 오정보의 전파 속도가 빨라졌다는 것이다.

나탈리 스트라우드 미국 텍사스대 오스틴캠퍼스 교수는 ‘소셜미디어와 오정보’를 주제로 한 세 번째 발표에서 소셜미디어가 오정보를 빠르게 유포시키기 때문에 주의를 기울여야 한다고 말했다. 그는 “2016년 미국 대선 기간에 소셜미디어에서 진짜 뉴스보다 오정보가 더 많이 유통됐다는 분석이 있다”며 “소셜미디어는 가짜뉴스를 자유롭게 퍼 나르는 공유의 장”이라고 지적했다.

가짜뉴스에 ‘논쟁적’ 대신 ‘거짓’ 표시해야

스트라우드 교수는 오정보를 ‘가장 타당성 있는 근거에 기반을 두었으나 정확하지 않은 정보’라고 정의하면서, 오정보는 근절할 수 있다고 주장했다. 그는 문제가 있는 콘텐츠를 적발하고 사실여부를 가리는 ‘팩트체크’ 활동, 오정보를 공유한 경력이 있는 사람들을 플랫폼에서 차단하는 방법 등을 예시했다.

그는 팩트체크가 된 콘텐츠를 어떻게 전달하는지도 중요하다고 지적했다. 한때 페이스북은 문제가 있는 콘텐츠에 빨간색 깃발 모양과 함께 ‘논쟁적’이라는 표시를 했다. 스트라우드 교수는 “이는 오히려 오정보가 지나치게 관심을 끌게 하는 방식”이라고 지적했다. 정보의 내용에 문제가 있는 게 아니라, 정보를 두고 팩트체커들 사이에 갈등이 있는 것처럼 보인다는 것이다. 그는 ‘이 기사는 거짓’이라고 직설적이고 분명하게 표현해야 한다고 강조했다.

스트라우드 교수는 소셜미디어와 협력하는 것도 중요하다고 말했다. 오정보가 끊임없이 진화하고 있는 상황에서 오정보가 어떻게 생성되고 공유되는지, 사람들에게 어떤 영향을 미치는지 연구와 조사가 필요하다는 것이다. 그는 “필요한 데이터를 플랫폼 사업자들에게 받아서 관련 연구를 진행해야 한다”고 말했다.

“기술은 오정보의 원인이자 해결책”

토론에 나선 한규섭 교수는 “기술과 매체중심적 시각에서는 시장의 규제와 언론, 시민단체, 팩트체크 기관 등의 오정보 감시를 통해 문제를 해결할 수 있다는 기대를 하는 듯하다”며 “현 시대는 과거와 비교해 기술변화 말고도 정치환경 변화가 크기 때문에 과도한 기술중심적 사고는 주의해야 한다”고 지적했다. 그는 “정치적 양극화가 세계적으로 심화하고 있다”며 “양극화가 오정보를 유발하고, 오정보가 효과를 발휘할 수 있는 환경과 동기를 제공한다”고 말했다. 이어 “기술은 불순한 동기를 가진 사람들이 손쉽게 활용할 수 있는 도구로서, 제한적인 관점으로 봐야 한다”고 덧붙였다.

세미나 사회를 맡은 이은주 교수는 “기술이 오정보의 원인이 되기도 하지만, 한편으로 해결책이 될 수도 있다”며 “인공지능(AI) 같은 기술을 이용해 사람과 비교할 수 없이 허위정보를 많이 생산할 수도 있지만, 그걸 잡아내는 것도 기술의 역할”이라고 강조했다. 결국 어떤 방향으로 기술을 활용하는지가 중요하다는 것이다.

이날 행사에 이어 오는 19일과 26일에는 ‘오정보, 음모와 혼란’ ‘디지털 저널리즘’ ‘가짜뉴스에 어떻게 대응할 것인가’ ‘미디어의 정서적 역학과 정치적 오정보’ 등을 주제로 2차와 3차 세미나가 열린다.

편집 : 이예진 PD

단비뉴스 환경부, 디지털뉴스부, 시사현안팀 김은초입니다.

불편(不便)하고 불편(不偏)하게.